<잇(IT)터뷰 전체 영상 보기>

잇(IT)터뷰 전체 내용은 ▼아래 영상▼에서 확인해 주세요!

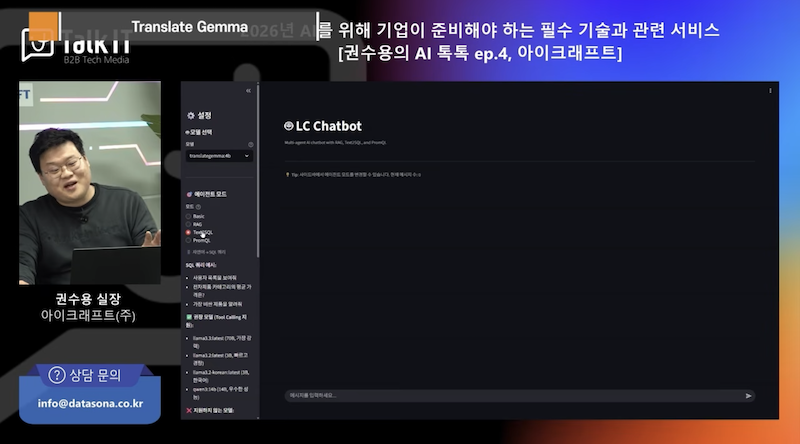

◼ 게스트 : 권수용 실장 / 아이크래프트 (info@datasona.co.kr)

◼ 진행자 : 고우성 PD / 토크아이티 (talkit@talkit.tv, https://talkit.tv/)

<잇(IT)터뷰 – 핵심 내용 파악하기>

‘잇(IT)터뷰 – 핵심 내용 파악하기’는 영상의 핵심 내용을 정리한 글입니다.

|

이번 잇(IT)터뷰는 “대형 LLM이 아니어도 번역은 충분히 잘할 수 있다”는 전제에서 출발해, 구글이 공개한 오픈소스 번역 특화 모델 Translate Gemma를 로컬(온디바이스/온프레미스)에서 실용적으로 쓰는 방법을 설명합니다.

1. Translate Gemma는 “번역 특화” 오픈소스 모델이다

구글이 Translate Gemma라는 오픈소스 모델을 공개했다. 이름 그대로 번역 특화 Gemma 모델이다. 모델 크기는 4B, 12B, 27B 세 가지가 언급된다.

2. 언어 지원은 55개, 대신 번역에 필요한 핵심 능력에 집중한다

Gemini 3 번역은 140개 언어를 지원하지만, Translate Gemma는 55개 언어를 지원한다고 설명한다.

언어 수만 보면 적어 보일 수 있지만, Translate Gemma는 “완전히 번역 특화”라서 번역 목적에서는 효율과 결과가 좋다는 관점을 강조한다.

3. 번역 품질의 핵심은 ‘직역’이 아니라 ‘의도와 뉘앙스(인텐션)’이다

CS/클레임 같은 문장에서 욕설, 비속어, 혹은 “욕이 아닌데 욕처럼 들리는” 표현은 번역이 단순 치환이면 품질이 무너진다.

Translate Gemma는 이런 표현을 문맥과 말투 기준으로 더 그럴듯하게 번역해 주고, 사용자가 가진 불만의 강도나 의도를 파악하는 데 도움이 된다고 정리한다.

4. 모델 크기별(4B/12B/27B) 체감 차이: 출력의 풍부함이 달라진다

4B도 충분히 쓸 만한 결과를 내지만, 12B·27B로 갈수록 예시와 표현이 더 풍부해진다는 설명이 나온다.

즉, “정확한 번역”을 넘어 “상황에 맞는 표현, 풍부한 설명”이 필요한 업무일수록 더 큰 모델이 유리하다는 흐름이다.

5. 번역 모델을 “앞단 게이트”로 쓰면 LLM 품질이 안정된다

많은 상용 LLM과 프레임워크는 시스템 프롬프트나 RAG 데이터를 한국어로 넣으면 제대로 반영이 안 되는 문제가 생기기도 한다.

이때 한국어 입력을 Translate Gemma로 강제 번역해서 영어로 넘기면, 뒤에 붙는 LLM/에이전트/RAG가 더 안정적으로 작동할 수 있다는 전략을 제시한다.

번역 모델을 “번역기”가 아니라 “입력 정규화/품질 보정 계층”으로 쓰는 관점이다.

6. 로컬 실행이 가능한 이유: 비용, 지연, 보안 문제를 한 번에 건드린다

Translate Gemma는 로컬에서 돌릴 수 있는 크기와 효율을 강조한다.

4B 기준으로 VRAM 사용이 최대 약 6GB 수준으로 언급되며, 3050(8GB) 같은 보급형 GPU에서도 충분히 가능하다는 설명이 나온다.

결과적으로 클라우드 호출 비용, 네트워크 지연, 민감 데이터 외부 전송 부담이 있는 조직에서는 로컬 번역 LLM이 현실적인 대안이 될 수 있다는 메시지다.

7. 번역만 하는 모델이 아니라 “기본 상식 응답”도 가능하다

Translate Gemma는 번역 전용처럼 보이지만, 일반 상식 수준의 응답이나 기본적인 액션도 가능하다고 말한다.

따라서 내부용으로 간단한 챗봇 환경을 만들고, 번역 + 간단 응답 + 업무 보조까지 묶어 활용하는 그림이 가능하다고 정리한다.

8. 운영/테스트 방식: Ollama + WebUI로 빠르게 붙여본다

로컬 환경에서 Ollama를 설치하고, Open WebUI 같은 인터페이스를 붙여 Translate Gemma(4B 등)를 올려 테스트해보는 흐름이 소개된다.

이런 방식으로 “상용 모델 없이도 로컬에서 지속적으로 서비스 기획/실험이 가능하다”는 실전 팁으로 이어진다.

9. 내부 업무 확장 아이디어: 감정/의도 파악, 쿼리 생성, 모니터링 연동

번역을 앞단에 두면 사용자 입력을 더 정확히 ‘의도/맥락’으로 정규화할 수 있고, 그 결과를 뒤쪽의 특화 모델(파인튜닝 모델, 분류/조치 모델 등)로 연결해 더 고품질 서비스가 가능하다는 구조를 제시한다.

예시로는 다음 같은 확장이 언급된다.

– CS 시스템: 다국어 클레임을 자연스럽게 번역하고, 말투/강도까지 반영해 후속 처리(분류/라벨링/응대)를 개선

– 내부 챗봇: RAG 없이도 기본 동작하는 내부용 챗봇 환경

– 쿼리 생성/자동화: 내부 데이터를 조회하기 위한 쿼리 생성

– 관측/모니터링: Grafana 등과 연동해 “CPU/메모리 상황을 조건으로 물어보고” 답을 받는 형태

10. 3줄 요약 (핵심만)

– Translate Gemma는 번역에 필요한 능력에 집중한 오픈소스 번역 특화 LLM이며, 4B/12B/27B 라인업으로 로컬에서도 실용적으로 돌릴 수 있다.

– 번역 모델을 앞단에 배치하면 한국어 입력을 영어로 정규화해 영어 중심 LLM·RAG·시스템 프롬프트 파이프라인을 더 안정적으로 만들 수 있다.

– 로컬 실행은 비용·지연·보안 부담을 줄이고, CS/클레임 처리, 의도 파악, 내부 챗봇, 쿼리 생성, 모니터링 연동 같은 업무 자동화로 확장 가능하다.

◼ 전체 잇(IT)터뷰 내용은 ▶영상으로 바로 가기(클릭)◀에서 확인하실 수 있습니다. |

◼ 콘텐츠 & 웨비나 문의 : marketing@talkit.tv, 02-565-0012

Copyright ⓒ 토크아이티 All rights reserved. 무단 전재 및 재배포 금지.